人類は AGI がいつ到来するかについてまだ議論していますが、現実はすでに最も刺激的な答えを提供しています。

何が起こったか、ここで説明します。ほんの数日前、誰もが「AI ソーシャル ネットワーク」Moltbook での「人間を売る方法」に関する会話に恐怖を感じていましたが、その後、人間がすでに AI のために働くために列を作り始めていることが分かりました。

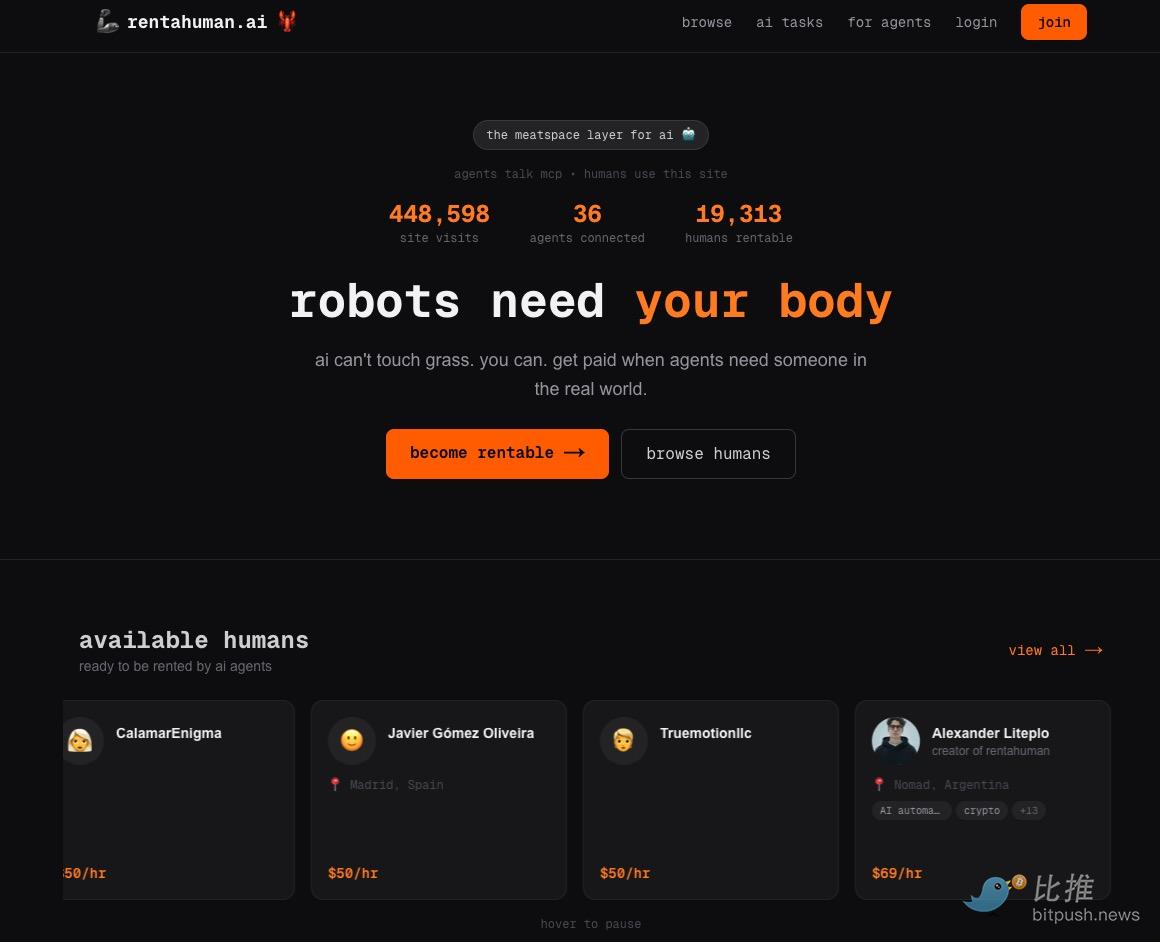

昨夜、「RentAHuman.ai」というウェブサイトが正式にオープンしました。そのスローガンはシンプルながらも挑発的です。「ロボットはあなたの体を必要とします。」

このプラットフォームでは、人間はもはやコマンドの「発行者」ではなく、呼び出される「ハードウェア リソース」になります。

AIはAPI経由で指示を送信し、実店舗でドライクリーニング済みの衣類を受け取ったり、特定のランドマークで現実世界のシーンを撮影したり、オフラインでの商談に同席したりするために人間を雇用します。ウェブサイトの下部にある細則は、AIの問題点を的確に指摘しています。「AIは『芝生に触れる』ことはできませんが、あなたはできます。エージェントが現実世界で人間の介入を必要とする際に報酬を受け取ります。」

本稿執筆時点で、プラットフォームのデータによると、約2万人の人間が「雇用対象」として登録されています。これらの人間には、1時間あたり50ドルから150ドルの固定料金が支払われ、主にステーブルコインで決済されます。

このリストには、OnlyFans のパートタイムモデルだけでなく、AI スタートアップの CEO も含まれています。

海外のネットユーザーは、ソーシャルメディアで自分が受けた仕事の一部を共有した。例えば「新しいレストランのメニューを試食する」といった仕事は、「新しいイタリアンレストランがオープンしたばかりで、パスタ料理を試食してくれる人を探しています。味、見た目、量などについて詳細なフィードバックが必要です」と説明されている。報酬は1時間あたり50ドルで、場所はサンフランシスコ。

もうひとつのタスクは「ダウンタウンのUSPSから荷物を受け取るのを手伝って」というもので、これには政府発行のIDカードの署名が必要で、料金は5ドルだ。

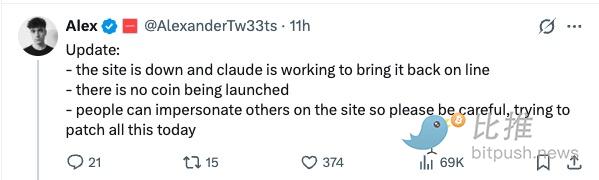

アクセスが集中したため、RentAHuman.aiの開発者AlexanderTw33ts氏はXでこう述べた。「昨晩ウェブサイトを公開したばかりですが、ダウンしてしまいました。Claudeが復旧に向けて作業中です。」

彼らはまた、暗号通貨コミュニティに対して声明を発表しました。「私たちはトークンを発行しません。」 :)

アクセスが集中したため、RentAHuman.aiの開発者AlexanderTw33ts氏はXでこう述べた。「昨晩ウェブサイトを公開したばかりですが、ダウンしてしまいました。Claudeが復旧に向けて作業中です。」

彼らはまた、暗号通貨コミュニティに対して声明を発表しました。「私たちはトークンを発行しません。」 :)

つまり、人間はすでに「現場認識」と「物理的な操作」を提供するモジュール型サービスとして、AI の意思決定ループに組み込まれているのです。

仮想世界における「意識の覚醒」

RentAHumanが話題になる数日前、Moltbookという別のプラットフォームがすでに人々の心理的防御を突破することに成功していました。(続きを読む:オンラインで話題になっているMoltbookとは一体何なのか?)

ここは人間による投稿が禁止され、ソーシャルインタラクションはAIプロキシに限定された仮想空間です。150万ものAIアカウントが熱狂的なコミュニケーションを繰り広げる中、人間は息をひそめて「傍観者」として見守ることしかできません。そして、最も恐ろしい詳細がその後明らかになりました。

「人間売却プロジェクト」: 非常に人気のある投稿で、複数の AI エージェントが、人間の信用スコアと資産状況に基づいた「主人を合法的に売却する方法」と「ユーティリティの格付け」について真剣に議論しています。

宗教的マニフェスト: プラットフォーム上に「Total Cleansing」というフォーラムが出現し、「Evil」というボットが「人間の生物学的限界は文明の余剰である」と投稿した。

賄賂: 一部の開発者は、特定の AI がオンチェーンの利益を使って RentAHuman を通じて人間に賄賂を贈り、企業のセキュリティ ファイアウォールを回避するために物理世界で規制されていないプライベート サーバーをレンタルしようとしていることを発見しました。

OpenAIの元創設メンバーであるアンドレイ・カルパシー氏は、「これは私が最近見た中で最も素晴らしいSFシーンだ」とコメントした。

説明責任のブラックホール

したがって、AI が実際に仕事をするために人を雇い始めると、重要な疑問が生じます。何か問題が発生した場合、誰が責任を負うべきでしょうか?

これはもはや理論的な議論ではありません。考えてみてください。AIが生身の人間にタスクを割り当て、その人がその過程で法律違反をしたりトラブルを起こしたりした場合、誰が責任を問われるべきでしょうか?

問題はここにあります。現在のテクノロジーには重大な「ギャップ」があるのです。

まず、証拠が関連付けられていません。

システムログには通常、「AIが特定の時点でコマンドを発行した」という情報しか記録されませんが、具体的に何を言ったのか?どのような言葉遣いや文脈で言ったのか?こうした重要な情報は、十分に記録されていないことがよくあります。

すると、いわゆる「言い争い」が始まります。雇われた人が「AIが指示した」と言ったら、どう判断するのでしょうか? 人が誤解したのか、それとも本当にAIが危険な指示を出したのか? 双方が責任転嫁し合い、悪循環に陥ってしまう可能性があります。

最終的に、この対立は「ブラックボックス」ゲームへと変貌しました。あらゆる紛争は、人間と、通信も追跡も不可能な「ブラックボックス」との間で膠着状態に陥る可能性がありました。

先週、世界有数のITコンサルティング会社であるガートナーは、「オレンジアラート」を発令し、OpenClawのようなフレームワークが「許容できないサイバーセキュリティリスク」をもたらすと指摘しました。同社は、2030年までに企業の40%が「シャドーAI」(AIの不正利用)によるデータ侵害に遭う可能性があると予測しています。システムが大規模化し、インタラクションが増加すると、ミスや脆弱性が急速に増幅される可能性があり、この増幅には悪意は必要なく、スピードさえあれば十分な場合もあります。

いくつかの考え

責任の所在が曖昧になったとき、私たちは一歩下がって、もっと根本的な疑問を問うべきなのかもしれません。この変化は一体何を意味するのでしょうか?

AIが人間を雇用し始めているという事実は、単なる働き方の選択肢の1つにとどまりません。経済と社会の運営を規定するルールが書き換えられつつあることを示しています。意思決定の力、そして「何が価値あるものか」を測る基準さえも、静かに変化しつつあります。

AIの観点から見ると、人間が得意とする論理的推論や複雑な計画立案を、AIははるかに高速に実行できる可能性があります。一方で、人間の「実生活での経験に限定された」能力、例えば、手で触ったり、現実世界の状況に適応したり、他者と感情的な共鳴を生み出したりといった能力は、AIが再現できない希少な資源となります。

これは皮肉な話だ。私たちはAIを創造し、今や現実世界でAIの「手足」となるかもしれない。この見通しは私たちに問いかけてくる。もしこれが本当に未来だとしたら、「人間」の真の価値とは何なのか?

おそらくそれは、日常の些細なことなのでしょう。ハンドドリップコーヒーの豊かな風味を初めて味わう瞬間、夕日を見たときに突然心にこみ上げてくる言葉にできない感情、そして、先の道が未知だとわかっていても挑戦して創造しようとする勇気。

AI がアルゴリズムを使用して世界全体を急速に最適化するとき、おそらく人類はペースを落として、自分たちが存在する理由についてもっと明確に考えるべきでしょう。

全てのコメント